Cet article est le deuxième d’une série en 6 parties

- 1ère partie: Introduction

- 2ème partie: Le moteur du changement

- 3ème partie: Création très destructrice

- 4ème partie: La voiture autonome

- 5ème partie: Des sirènes et des plateformes

- 6ème partie: Conclusion

–

Quel est le moteur des changements que nous commençons à percevoir dans la structure du travail? Les technologies numériques. Comme je le dis parfois, toute industrie qui n’a pas encore été boulversée par le numérique va l’être… ce qui ne protège celles qui l’ont déjà été de l’être de nouveau. L’informatique de gestion est là depuis plus de 40 ans, Internet depuis 20 ans, mais nous sommes encore loin d’avoir tout vu.

Comme l’expliquent plusieurs livres et articles, tout ceci se résume à une loi: la loi de Moore, qui stipule grosso modo que la puissance de calcule double tous les deux ans ou même tous les 18 mois (dans son énoncé original, la loi est un plus technique que ça, mais elle se simplifie assez facilement ainsi.) Nous prenons pour acquis cette croissance constante, mais nous sommes pas réellement capable de comprendre ce qu’elle signifie et toutes les évolutions que cela peut amener.

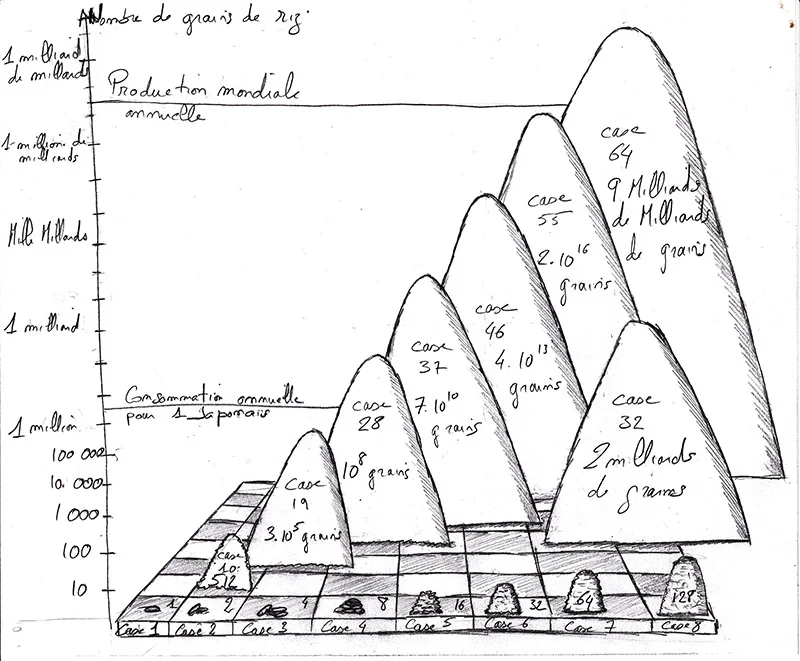

Dans Race against the Machine, les auteurs racontent une légende concernant l’inventeur du jeu d’échec qui enchanta l’Empereur de Chine en lui expliquant sa création. En guise de remerciement, l’empereur proposa à l’inventeur choisir le présent qu’il souhaitait. L’inventeur mis un grain riz sur la première case de l’échiquier, deux sur la seconde, et doublant ainsi de suite demanda autant de riz qu’en contiendrait la 64ème case. La demande semblait honnête et l’empereur accepta… jusqu’à ce que ses scribes executent le calcul et se rendent compte qu’à la 32ème case, cela représentait déjà un nombre immense (en l’occurrence 2 milliards de grain de riz, soit 40 tonnes de riz). En bout de ligne, la 64ème case aurait contenu 9 milliards de milliards de grains de riz (9.1018, environ 180 milliards de tonnes de riz ou encore, si je ne me trompe pas trop, une montage de riz d’environ 8km de haut et 10km de diamètre au sol), soit plus que toute la production mondiale de riz depuis l’avènement de l’agriculture (voir illustration ci-dessus).

La conclusion des auteurs: l’entendement humain ne pas appréhender le concept de doublement récurrent qui rapidement amène des quantités simplement inimaginables –sérieusement, qui peut s’imaginer ce que représente 1018?). C’est ce que nous fait vivre l’informatique. Cette augmentation constante de la capacité à fourrer plus de transistors et diodes dans moins d’espace nous permet maintenant numériser le monde à grande échelle, d’amener dans le monde virtuel les concepts du réel. À partir de ce moment, ce n’est plus qu’une question de temps avec de pouvoir en faire ce qu’on veut.

D’ailleurs se contenter de regarder la loi de Moore ne suffit pas. Les avancées en matière de développement logiciel amènent aussi leur lot d’améliorations. Pour donner un exemple, lorsque j’ai commencé à la Bourse de Montréal, en 2005, les délais de réponse de l’engin de trading, qui datait de 2002, était de l’ordre de la seconde pour un nombre d’ordres assez faible (quelques milliers). En 2010, les temps de réponse étaient descendus à la milliseconde (un facteur de 1000!) pour traiter des centains de milliers d’ordres (là encore un facteur entre 100 et 1000), le tout sur des machines pas tant que ça plus puissantes. Les améliorations en matière de logiel ont un effet multiplicateur sur la puissance matérielle.

Et le logiciel libre commence à jouer un rôle d’accélérateur: maintenant une quantité impressionnante de “briques” sont disponibles en logiciel libre. À titre d’exemple, on répète souvent que le stack de Twitter est à 80% en logiciel libre.

Et le matériel suit la même tendance -qui découle de la loi de Moore quelque part: des composants électroniques toujours plus petits, plus économes, qui peuvent désormais être intégrés partout à bas prix. Qu’il s’agisse de giroscopes, de caméras, de communications sans fil, de scanners et imprimantes 3D, de senseurs de toutes sortes, toutes ces composantes qui voilà quelques années coutaient chères et étaient encombrantes et qui tiennent maintenant dans la main, voire dans un téléphone cellulaire. Là aussi, ce savoir est rapidement “commodisé” sous forme de briques prêtes à l’emploi avec Arduino ou Rasberry Pi.

Grâce à tout cela, il est désormais facile de réaliser ce qui aurait nécessiter des investissements majeurs. C’est ce qui nous permet d’avoir les Google Glass ou des quadcopters chargés de senseurs et de communication sans fil leur permettant de se lancer un bâton ou de réaliser des tâches collaboratives.

Intelligence artificielle, machine learning, réconnaissance de caractères, simulations réalistes. Tout ce qui était décevant au début des années 2000 commence à prendre un air de réalisme. Non, ce n’est pas demain que nous verrons un Terminator ou un C-3PO sortir d’usines de production. En revanche, comme le montre l’exemple des quadcopters, les robots et les algos sont de plus en plus capables d’émuler des compétences précédemment considérées comme purement humaines: lancer une tige et la récupérer en équilibre, avec tous les degrés d’incertitude que cela représente, est un défi immense, mais maintenant faisable.

La conséquence directe, c’est que de plus en plus de tâches entrent dans le périmètre d’action de la machine. Les ponts entre le numérique et les réels sont maintenant acquis: que ce soit les informations de notre métabolisme, la forme de notre corps, notre position géographique, nos habitudes de vie, nos préférences, tout peut être projeté sous forme de bits, tout peut être manipulé, analysé et reproduit.

L’informatisation, au sens large du terme, est une vague qui double tous les deux ans: le chateau de sable qui lui résistait difficilement l’année dernière succombera l’année prochaine.

Le prochain article expliquera comment cette puissance de calcul et cette numérisation du monde à grande échelle changent et vont changer notre travail.

⁂

What all this comes down to is that the very idea of artificial intelligence gives us the cover to avoid accountability by pretending that machines can take on more and more human responsability.

Jaron Lanier, Who owns the future